- L'intelligenza artificiale che ammette i propri limiti

- Cos'è la Neuro-Symbolic AI e perché cambia le regole del gioco

- Dove l'errore non è contemplato: guida autonoma e oncologia pediatrica

- Da laboratorio a impresa: lo spin-off Strea Srl

- Un'IA green, sicura e spiegabile

- Domande frequenti

L'intelligenza artificiale che ammette i propri limiti

C'è un dettaglio che distingue il lavoro di Aniello Murano da buona parte della ricerca mainstream sull'intelligenza artificiale. Il suo sistema è progettato per fare una cosa che i grandi modelli generativi — da ChatGPT a Gemini — evitano sistematicamente: dire "non lo so".

Può sembrare poco. In realtà è una rivoluzione concettuale. Perché un'IA capace di riconoscere i confini della propria conoscenza è, per definizione, un'IA più sicura. Ed è esattamente ciò che serve quando la posta in gioco non è generare un testo convincente, ma prendere una decisione da cui dipende la vita di una persona.

Murano, professore ordinario di Informatica presso l'Università degli Studi di Napoli Federico II, lavora da anni a un approccio che non si limita a far apprendere la macchina dai dati — il paradigma dominante del deep learning — ma la fa ragionare attraverso modelli logici formali. Il risultato è una tecnologia che sta attirando attenzione crescente nel panorama della ricerca universitaria a Napoli e ben oltre i confini nazionali.

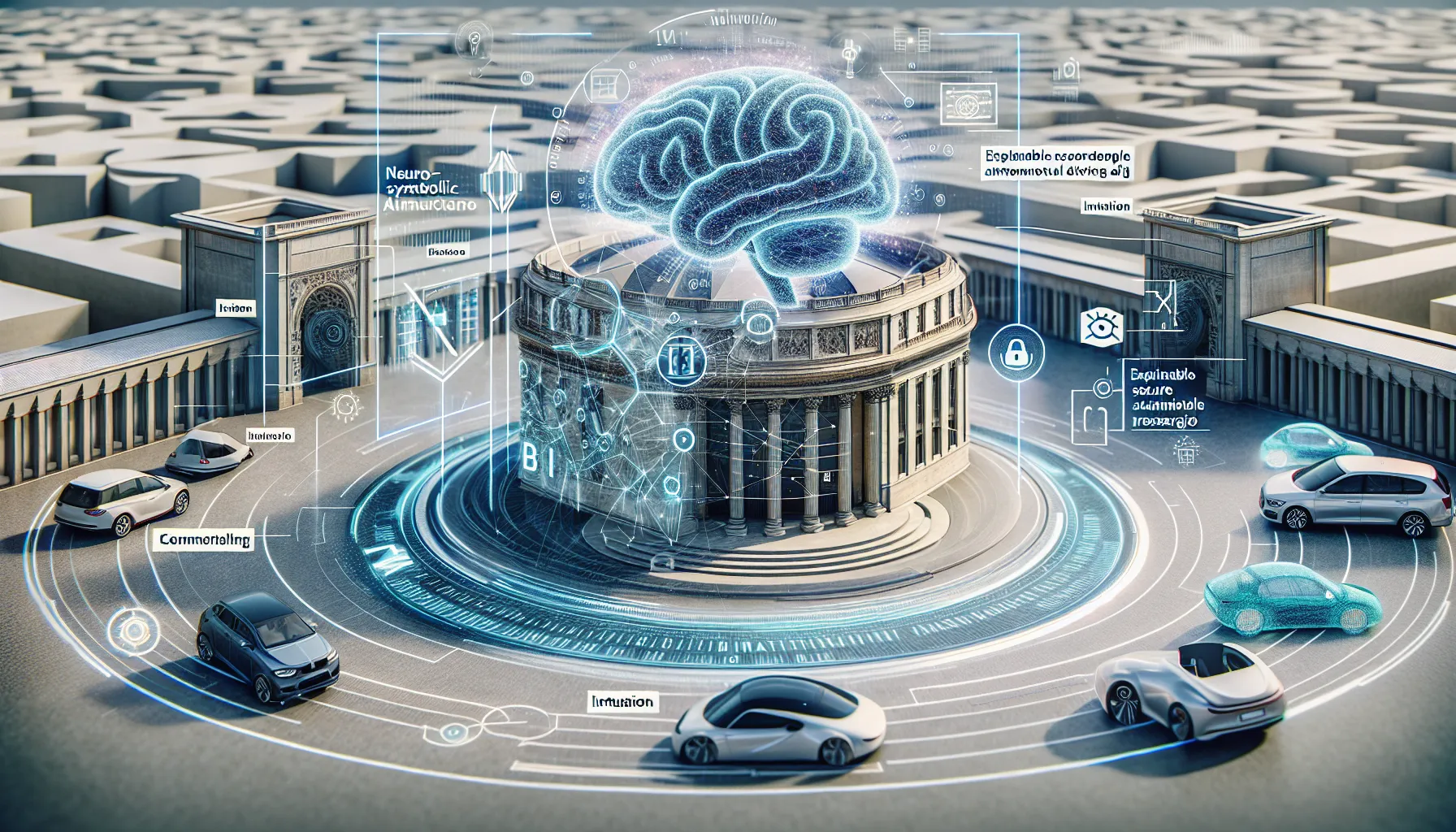

Cos'è la Neuro-Symbolic AI e perché cambia le regole del gioco

Per comprendere la portata di questo filone di ricerca, occorre fare un passo indietro. L'intelligenza artificiale contemporanea si muove lungo due binari storicamente paralleli.

Da un lato c'è l'IA generativa, quella dei modelli neurali profondi: sistemi che imparano da enormi quantità di dati, riconoscono pattern, producono testi, immagini, codice. Sono straordinariamente potenti ma sostanzialmente opachi. Nessuno — nemmeno i loro creatori — è in grado di spiegare con certezza *perché* un modello genera una determinata risposta piuttosto che un'altra. Quando sbagliano, lo fanno con assoluta disinvoltura. Le cosiddette hallucinations non sono un bug occasionale: sono una caratteristica strutturale.

Dall'altro lato c'è l'IA simbolica, la tradizione dell'intelligenza artificiale classica, quella nata negli anni Cinquanta nei laboratori del MIT e di Stanford. Qui la macchina non impara dai dati: segue regole, manipola simboli, opera deduzioni logiche. È trasparente, verificabile, rigorosa. Ma anche rigida, lenta nell'adattarsi, incapace di gestire l'ambiguità del mondo reale.

La Neuro-Symbolic AI — letteralmente, intelligenza artificiale neuro-simbolica — rappresenta il tentativo di fondere queste due anime. Non si tratta di un compromesso al ribasso, ma di una vera e propria terza via: un'architettura ibrida in cui la capacità di apprendimento delle reti neurali si combina con la certezza matematica del ragionamento formale.

Stando a quanto emerge dal lavoro del gruppo di Murano, il vantaggio è duplice. Il sistema mantiene la flessibilità necessaria per operare in ambienti complessi e imprevedibili, ma al tempo stesso è in grado di giustificare ogni singola decisione attraverso una catena logica verificabile. Un'IA, insomma, che non solo agisce, ma *spiega perché*.

Dove l'errore non è contemplato: guida autonoma e oncologia pediatrica

È nei cosiddetti safety-critical domains che la differenza tra un'IA opaca e un'IA spiegabile diventa una questione di vita o di morte. Murano e il suo team lo sanno bene: le applicazioni su cui stanno lavorando non lasciano margine all'approssimazione.

Il primo ambito è la guida autonoma. Un veicolo a guida automatizzata deve prendere migliaia di micro-decisioni al secondo — frenare, sterzare, accelerare, cedere il passo — e ciascuna di queste decisioni deve essere non solo corretta, ma anche *tracciabile*. Se un'auto a guida autonoma provoca un incidente, la domanda "perché il sistema ha fatto questa scelta?" non può restare senza risposta. I modelli puramente neurali, per quanto performanti, non offrono garanzie su questo fronte. Un sistema neuro-simbolico, invece, è progettato per rendere conto delle proprie azioni.

Il secondo ambito, forse ancora più delicato, è l'oncologia pediatrica. Qui l'IA viene impiegata come strumento di supporto decisionale per i medici: analisi di imaging, suggerimenti terapeutici, valutazione prognostica. La posta in gioco è altissima e la fiducia del clinico nel sistema dipende interamente dalla capacità di quest'ultimo di motivare le proprie raccomandazioni. Un'IA che suggerisce un protocollo terapeutico senza poter spiegare il ragionamento sottostante è, semplicemente, inutilizzabile in un reparto ospedaliero.

Come sottolineato dallo stesso Murano, la capacità del sistema di dichiarare "non ho informazioni sufficienti per rispondere" è un tratto distintivo cruciale. In medicina — ma lo stesso vale per la guida autonoma — un'incertezza riconosciuta è infinitamente preferibile a una certezza fasulla.

Da laboratorio a impresa: lo spin-off Strea Srl

La ricerca, però, non è rimasta confinata tra le mura del Dipartimento di Ingegneria Elettrica e delle Tecnologie dell'Informazione della Federico II. Murano ha fondato Strea Srl, uno spin-off accademico nato per trasferire i risultati della ricerca neuro-simbolica verso applicazioni industriali e commerciali concrete.

Il modello dello spin-off universitario è ormai consolidato nel sistema italiano della ricerca — il quadro normativo lo prevede esplicitamente, con il D.Lgs. 297/1999 e successive modifiche — ma resta ancora relativamente poco sfruttato, soprattutto nel Mezzogiorno. Il caso di Strea rappresenta dunque un segnale significativo: la dimostrazione che anche dalla ricerca di base più sofisticata può nascere un'impresa con ricadute economiche tangibili.

L'obiettivo dichiarato è portare la Neuro-Symbolic AI fuori dal perimetro accademico, rendendola disponibile per aziende, ospedali, enti pubblici e operatori del settore automotive che necessitano di soluzioni affidabili e certificabili.

Un'IA green, sicura e spiegabile

C'è un ultimo aspetto che merita attenzione, spesso trascurato nel dibattito pubblico sull'intelligenza artificiale: l'impatto ambientale. I grandi modelli generativi richiedono quantità enormi di energia per l'addestramento e l'inferenza. I data center che li ospitano consumano acqua e elettricità in proporzioni crescenti, al punto che alcune stime collocano l'impronta carbonica dell'IA generativa tra le voci più preoccupanti dell'economia digitale.

L'approccio neuro-simbolico, per sua natura, è significativamente meno energivoro. Non avendo bisogno di macinare miliardi di parametri per ogni singola risposta — parte del lavoro è svolto dal motore logico, che opera in modo deterministico — il consumo computazionale si riduce. Una tecnologia, dunque, che si candida a essere non solo più sicura e più trasparente, ma anche più sostenibile.

È una convergenza rara: sicurezza, spiegabilità, efficienza energetica. Tre qualità che il regolamento europeo sull'intelligenza artificiale — l'AI Act, entrato in vigore nell'agosto 2024 — pone esplicitamente al centro dei requisiti per i sistemi ad alto rischio. Il lavoro di Murano e del suo team sembra anticipare, con anni di ricerca alle spalle, esattamente le esigenze che il legislatore europeo ha codificato.

La questione resta aperta su molti fronti: scalabilità, adozione industriale, integrazione con le infrastrutture esistenti. Ma la direzione tracciata dalla Federico II di Napoli è chiara. E in un'epoca in cui l'intelligenza artificiale viene alternativamente celebrata come panacea o temuta come minaccia, un'IA che sa dire "non lo so" potrebbe essere la risposta più intelligente di tutte.

Domande frequenti

Che cos'è esattamente la Neuro-Symbolic AI?

È un approccio ibrido all'intelligenza artificiale che combina le reti neurali — tipiche dell'IA generativa, capaci di apprendere dai dati — con il ragionamento simbolico formale, basato su regole logiche e modelli matematici. L'obiettivo è ottenere sistemi che siano al contempo flessibili, trasparenti e verificabili.

In cosa si differenzia dall'IA generativa tradizionale?

L'IA generativa (come i modelli linguistici di grandi dimensioni) apprende statisticamente dai dati e produce risposte probabilistiche, senza poter spiegare il ragionamento sottostante. La Neuro-Symbolic AI integra un livello di ragionamento logico che rende ogni output tracciabile e giustificabile. Inoltre, è in grado di segnalare quando non dispone di informazioni sufficienti per fornire una risposta affidabile.

Perché è rilevante per settori come la guida autonoma o la medicina?

In ambiti dove un errore può avere conseguenze fatali, non basta che un sistema sia performante: deve anche essere spiegabile e certificabile. Un medico o un ingegnere devono poter comprendere perché l'IA ha suggerito una determinata azione. La Neuro-Symbolic AI risponde a questa esigenza.

Cos'è Strea Srl?

È lo spin-off accademico fondato dal professor Aniello Murano per trasferire i risultati della ricerca condotta alla Federico II di Napoli verso applicazioni industriali e commerciali, in particolare nei settori automotive e sanitario.

La Neuro-Symbolic AI è conforme all'AI Act europeo?

L'approccio neuro-simbolico è particolarmente allineato ai requisiti dell'AI Act per i sistemi ad alto rischio, che impongono trasparenza, spiegabilità e affidabilità. Pur non essendo una certificazione automatica, le caratteristiche intrinseche di questa tecnologia la rendono più facilmente conformabile al quadro regolatorio europeo.